Jeg føler mig bange. Meget bange.

Internet-dækkende overvågning og censur, muliggjort af kunstig intelligens (AI) ufatteligt store regnekraft, er her.

Dette er ikke en futuristisk dystopi. Det sker nu.

Regeringsorganer samarbejder med universiteter og nonprofitorganisationer om at bruge AI-værktøjer til at overvåge og censurere indhold på internettet.

Dette er ikke politisk eller partipolitisk. Det handler ikke om nogen bestemt mening eller idé.

Det, der sker, er, at et værktøj, der er kraftfuldt nok til at overvåge alt, hvad der bliver sagt og gjort på internettet (eller store dele af det) er ved at blive tilgængeligt for regeringen til at overvåge os alle, hele tiden. Og baseret på denne overvågning kan regeringen – og enhver organisation eller virksomhed, som regeringen samarbejder med – så bruge det samme værktøj til at undertrykke, tie og lukke ned enhver tale, den ikke kan lide.

Men det er ikke alt. Ved at bruge det samme værktøj kan regeringen og dens offentlig-private, "ikke-statslige" partnere (tænk for eksempel: Verdenssundhedsorganisationen eller Monsanto) også lukke enhver aktivitet, der er forbundet med internettet. Bankvirksomhed, køb, salg, undervisning, læring, underholdende, forbindelse til hinanden – hvis den regeringskontrollerede AI ikke kan lide, hvad du (eller dine børn!) siger i et tweet eller en e-mail, kan det lukke ned for alt det for du.

Ja, det har vi set i en meget lokal og politiseret målestok med f.eks. de canadiske vognmænd.

Men hvis vi troede, at denne type aktivitet ikke kunne eller ikke ville ske på nationalt (eller endda mere skræmmende – globalt) skala, er vi nødt til at vågne op lige nu og indse, at det sker, og at det måske ikke kan stoppes.

Nye dokumenter viser regeringsfinansieret AI beregnet til onlinecensur

Det amerikanske hus udvalgte underudvalg om våbengørelse af den føderale regering blev dannet i januar 2023 "for at undersøge sager relateret til indsamling, analyse, formidling og brug af oplysninger om amerikanske statsborgere af forvaltningsorganer, herunder om sådanne bestræbelser er ulovlige, forfatningsstridige eller på anden måde uetiske."

Desværre betragtes udvalgets arbejde, selv af dets egne medlemmer, som stort set politisk: Konservative lovgivere undersøger, hvad de opfatter som tavshed på konservative stemmer fra liberalt orienterede regeringsorganer.

Ikke desto mindre har denne komité i sine undersøgelser afsløret nogle forbløffende dokumenter relateret til regeringens forsøg på at censurere amerikanske borgeres tale.

Disse dokumenter har afgørende og skræmmende konsekvenser for hele samfundet.

I underudvalgets foreløbige rapport, dateret 5. februar 2024, viser dokumenter, at akademiske og nonprofit-grupper pitcherer et regeringsagentur om en plan om at bruge AI "misinformationstjenester" til at censurere indhold på internetplatforme.

Specifikt forklarer University of Michigan til National Science Foundation (NSF), at de AI-drevne værktøjer finansieret af NSF kan bruges til at hjælpe sociale medieplatforme med at udføre censuraktiviteter uden faktisk at skulle træffe beslutninger om, hvad der skal censureres.

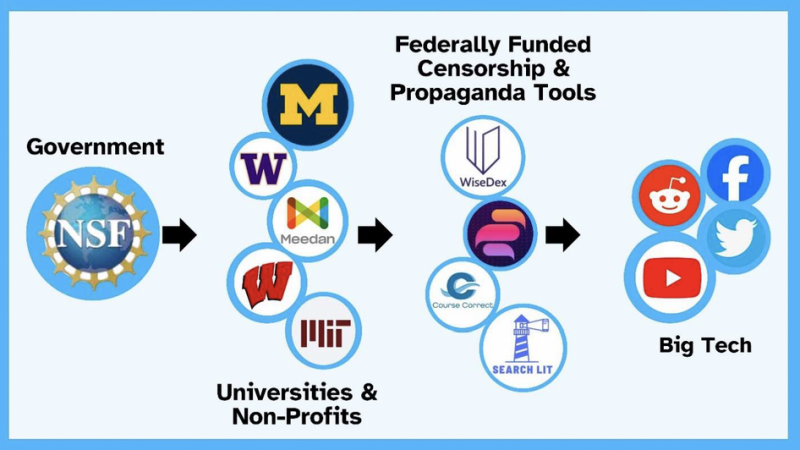

Sådan visualiseres forholdet i underudvalgets rapport:

Her er et specifikt citat i underudvalgets rapport. Det kommer fra "Speaker's notes fra University of Michigans første pitch til National Science Foundation (NSF) om dets NSF-finansierede, AI-drevne WiseDex-værktøj." Notaterne ligger hos udvalget.

Vores misinformationstjeneste hjælper politiske beslutningstagere på platforme, der ønsker at...skubbe ansvaret for svære domme til nogen uden for virksomheden...ved at eksternalisere det vanskelige ansvar censur.

Dette er en ekstraordinær udtalelse på så mange niveauer:

- Det sidestiller eksplicit "misinformationstjeneste" med censur.

Dette er en afgørende ligning, fordi regeringer verden over foregiver at bekæmpe skadelig misinformation, når de faktisk er vedtage massive censurregninger. Det WEF erklæret "misinformation og desinformation" de "mest alvorlige globale risici" i de næste to år, hvilket formentlig betyder, at deres største indsats vil gå mod censur.

Når en statslig entreprenør udtrykkeligt siger, at den sælger en "misinformationstjeneste", der hjælper onlineplatforme med at "eksternalisere censur" - er de to udtryk anerkendt som værende udskiftelige.

- Det refererer til censur som et "ansvar".

Det antager med andre ord, at en del af det, platformene burde gøre, er censur. Ikke at beskytte børn mod seksuelle rovdyr eller uskyldige borgere mod misinformation – bare ren og skær, uforfalsket censur.

- Den fastslår, at AIs rolle er at "eksternalisere" ansvaret for censur.

Tech-platformene ønsker ikke at træffe censurbeslutninger. Regeringen ønsker at træffe de beslutninger, men ønsker ikke at blive set som censurerende. AI-værktøjerne gør det muligt for platformene at "eksternalisere" censurbeslutningerne og regeringen til at skjule sine censuraktiviteter.

Alt dette burde gøre en ende på illusionen om, at det, regeringer rundt om i verden kalder "bekæmpelse af misinformation og hadefulde ytringer", ikke er direkte censur.

Hvad sker der, når AI-censur er fuldt implementeret?

Når vi ved, at regeringen allerede betaler for AI-censurværktøjer, er vi nødt til at vikle vores tanker omkring, hvad dette indebærer.

Ingen mandskabsbegrænsninger: Som underudvalgets rapport påpeger, har grænserne for regeringens onlinecensur indtil nu involveret det store antal mennesker, der er nødvendige for at gennemgå endeløse filer og træffe censurbeslutninger. Med AI behøver næsten ingen mennesker at være involveret, og mængden af data, der kan overvåges, kan være lige så stor som alt, hvad nogen siger på en bestemt platform. Den mængde data er uforståelig for en individuel menneskelig hjerne.

Ingen er ansvarlig: Et af de mest skræmmende aspekter af AI-censur er, at når AI gør det, er der intet menneske eller organisation – det være sig regeringen, platformene eller universitetet/nonprofitorganisationerne – der faktisk er ansvarlig for censuren. I første omgang giver mennesker AI-værktøjet instruktioner til, hvilke kategorier eller typer sprog, der skal censureres, men derefter går maskinen videre og træffer beslutninger fra sag til sag helt af sig selv.

Ingen klagemuligheder: Når AI er sluppet løs med et sæt censurinstruktioner, vil den feje adskillige millioner online datapunkter op og anvende censurhandlinger. Hvis du vil bestride en AI-censurhandling, bliver du nødt til at tale med maskinen. Måske vil platformene ansætte mennesker til at reagere på appeller. Men hvorfor skulle de gøre det, når de har AI, der kan automatisere disse svar?

Ingen beskyttelse for unge: En af påstandene fra regeringens censorer er, at vi er nødt til at beskytte vores børn mod skadelig onlineinformation, såsom indhold, der gør dem anorektiske, opmuntrer dem til at begå selvmord, gør dem til ISIS-terrorister og så videre. Også fra seksuel udnyttelse. Det er alle alvorlige spørgsmål, der fortjener opmærksomhed. Men de er ikke nær så farlige for et stort antal unge mennesker, som AI-censur er.

Faren ved AI-censur gælder alle unge, der bruger meget tid online, fordi det betyder, at deres onlineaktiviteter og sprog kan overvåges og bruges imod dem – måske ikke nu, men når som helst regeringen beslutter sig for at gå efter en bestemt type sprog eller adfærd. Dette er en meget større fare for et meget større antal børn end faren ved noget specifikt indhold, fordi det omfatter al den aktivitet, de udfører online, og berører næsten alle aspekter af deres liv.

Her er et eksempel til at illustrere denne fare: Lad os sige, at din teenager spiller masser af interaktive videospil online. Lad os sige, at han tilfældigvis favoriserer spil designet af kinesiske virksomheder. Måske ser han også andre spille de spil og deltager i chats og diskussionsgrupper om disse spil, hvor mange kinesiske statsborgere også deltager.

Regeringen kan beslutte i næste måned eller næste år, at enhver, der er stærkt engageret i kinesisk-designede videospil, er en fare for demokratiet. Dette kan resultere i, at du lukker din søns konti på sociale medier eller nægter ham adgang til finansielle værktøjer, såsom universitetslån. Det kan også involvere at markere ham på job- eller datingwebsteder som farlig eller uønsket. Det kan betyde, at han bliver nægtet pas eller sat på en overvågningsliste.

Din teenagers liv er blevet meget sværere. Meget sværere, end hvis han blev udsat for en ISIS rekrutteringsvideo eller selvmordsforherligende TikTok-indlæg. Og dette ville ske i meget større skala end seksuel udnyttelse, som censorerne bruger som en trojansk hest for at normalisere ideen om online regeringscensur.

Censurtjenester, der kan tjene penge på: Et AI-værktøj ejet af regeringen kan teoretisk bruges af en ikke-statslig enhed med regeringens tilladelse og med velsignelse fra de platforme, der ønsker at "eksternalisere" "ansvaret" for censur. Så selvom regeringen måske bruger kunstig intelligens til at overvåge og undertrykke, lad os sige som et eksempel, anti-krigsstemning – en virksomhed kunne bruge den til at overvåge og undertrykke, lad os sige som et eksempel, anti-fastfood-stemning. Regeringen kunne tjene mange penge på at sælge AI-værktøjernes tjenester til 3. parter. Platformene kunne også tænkes at bede om et snit. Således kan AI-censurværktøjer potentielt gavne regeringen, teknologiske platforme og private virksomheder. Incitamenterne er så stærke, at det næsten er umuligt at forestille sig, at de ikke vil blive udnyttet.

Kan vi vende kursen?

Jeg ved ikke, hvor mange offentlige myndigheder og hvor mange platforme der bruger AI-censurværktøjer. Jeg ved ikke, hvor hurtigt de kan skalere op.

Jeg ved ikke, hvilke værktøjer vi har til rådighed – andet end at øge opmærksomheden og forsøge at lobbye politikere og anlægge retssager for at forhindre regeringscensur og regulere brugen af AI-værktøjer på internettet.

Hvis nogen har andre ideer, ville det være tid til at implementere dem nu.

Udgivet under a Creative Commons Attribution 4.0 International licens

For genoptryk, sæt venligst det kanoniske link tilbage til originalen Brownstone Institute Artikel og forfatter.